API-Monitoring-Tools im Vergleich — LoadFocus vs. Pingdom, UptimeRobot, Datadog, New Relic

Fünf populäre API-Monitoring-Plattformen verglichen auf den Punkten, die Teams wirklich evaluieren: Check-Frequenz, mehrstufige Request-Flows, kostenloses Kontingent, Alert-Integrationen und Kosten bei realistischer Skalierung.

| Funktion | LoadFocus | Pingdom | UptimeRobot | Datadog | New Relic |

|---|---|---|---|---|---|

| Minimale Check-Frequenz | 30 Sekunden | 60 Sekunden | 60 Sekunden (1 Min) | 30 Sekunden | 30 Sekunden |

| Mehrstufige / verkettete API-Flows | Ja — Login + Token + Call | Transaction-Add-on | Nein | Ja (Synthetic API) | Ja (Synthetic Monitor) |

| Kostenloses Kontingent mit API-Checks | Ja — 5 Checks gratis | Nur Trial | 50 Monitors / 5 Min | Nur Trial | Frei bis 100 GB Ingest |

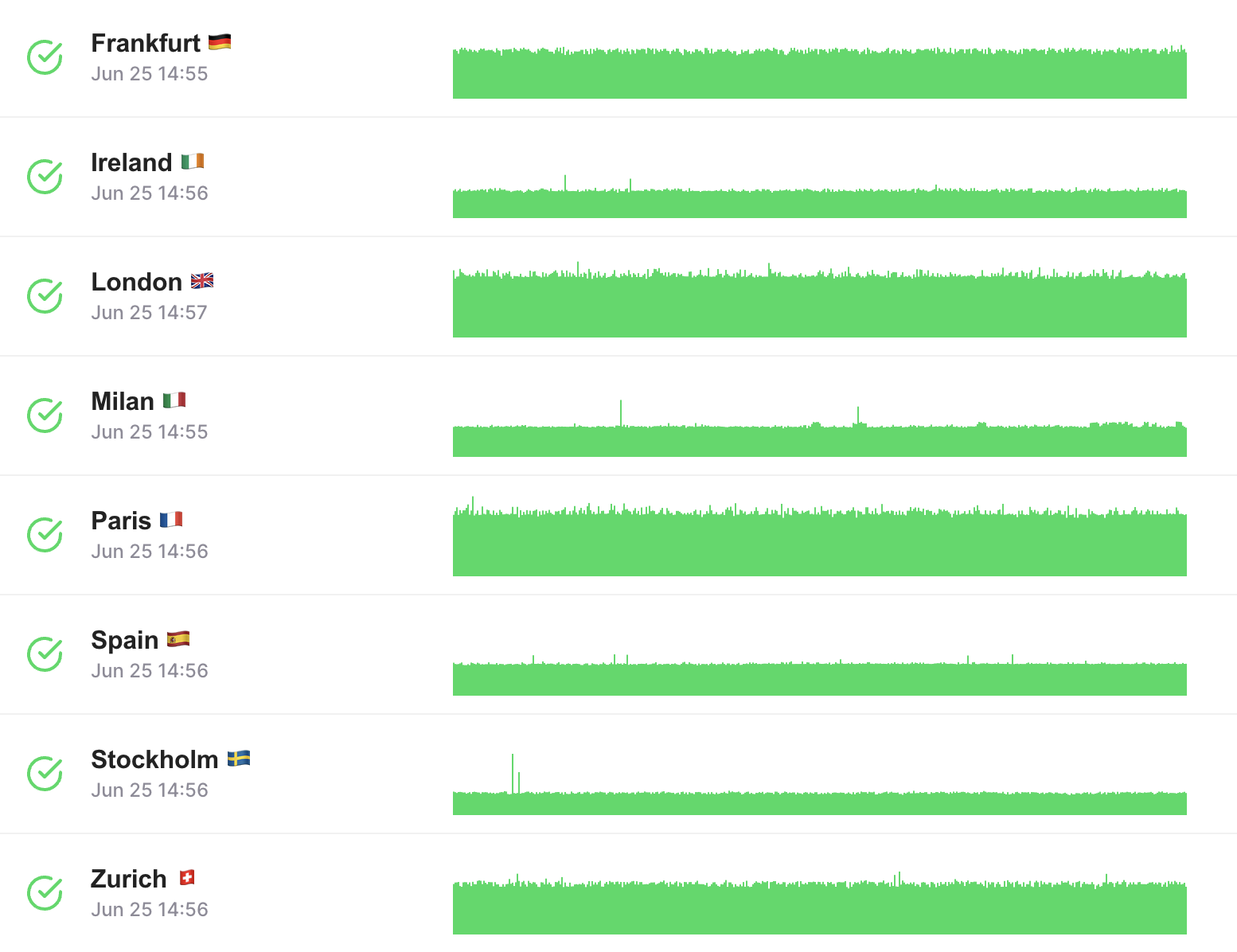

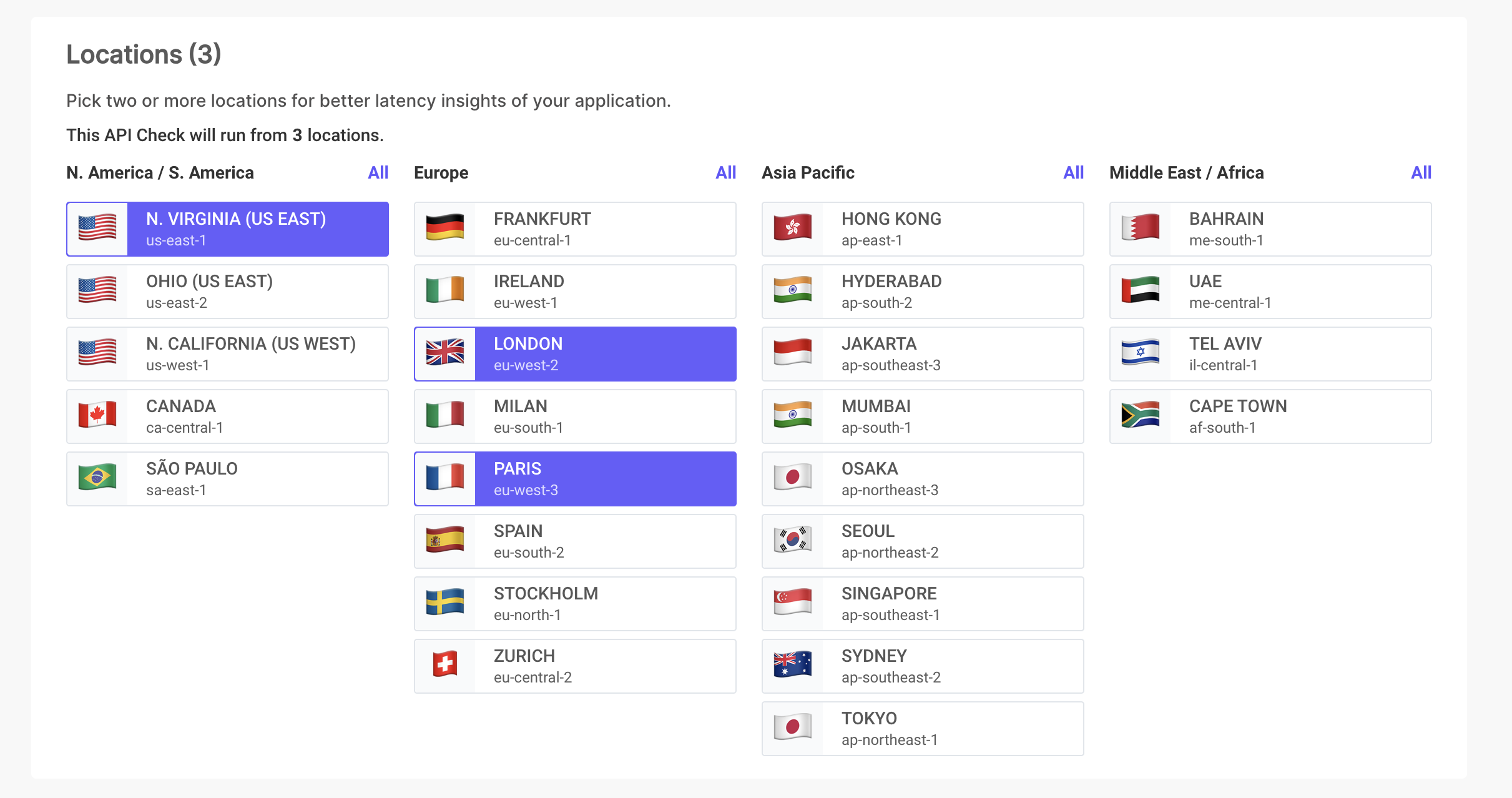

| Globale Check-Standorte | 26+ AWS-Regionen | 100+ | 13 | 20+ | 20+ |

| Alert-Integrationen (Slack, PagerDuty, Webhook) | Ja — alle drei | Ja | Ja | Ja | Ja |

| Preis für 50 Endpoints @ 1-Min-Checks | Ab 19 €/Monat | Ab 79 $/Monat | Ab 7 $/Monat (begrenzt) | Ab 5 $/Check/Monat | Nutzungsbasiert |

Die 4 API-Monitoring-Metriken, die Outages wirklich fangen

Uptime allein verpasst degradierte Performance. Diese vier Metriken sagen dir, ob deine APIs wirklich gesund sind — nicht nur erreichbar.

Antwortzeit (p95)

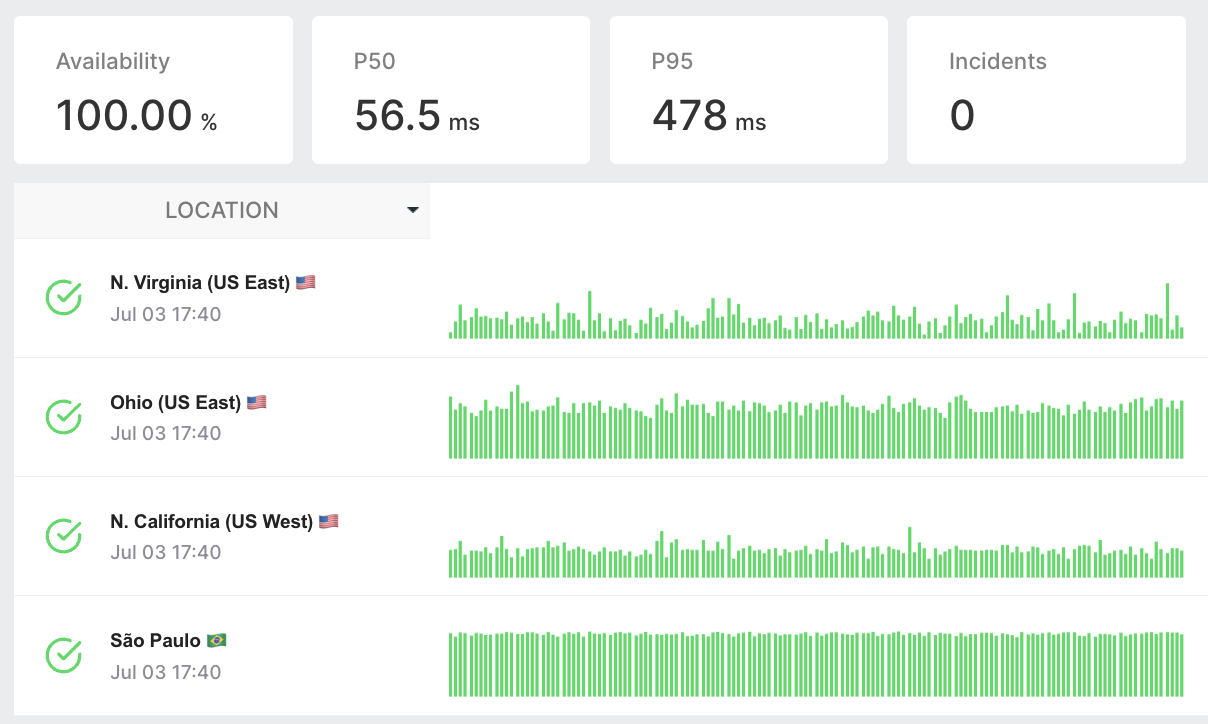

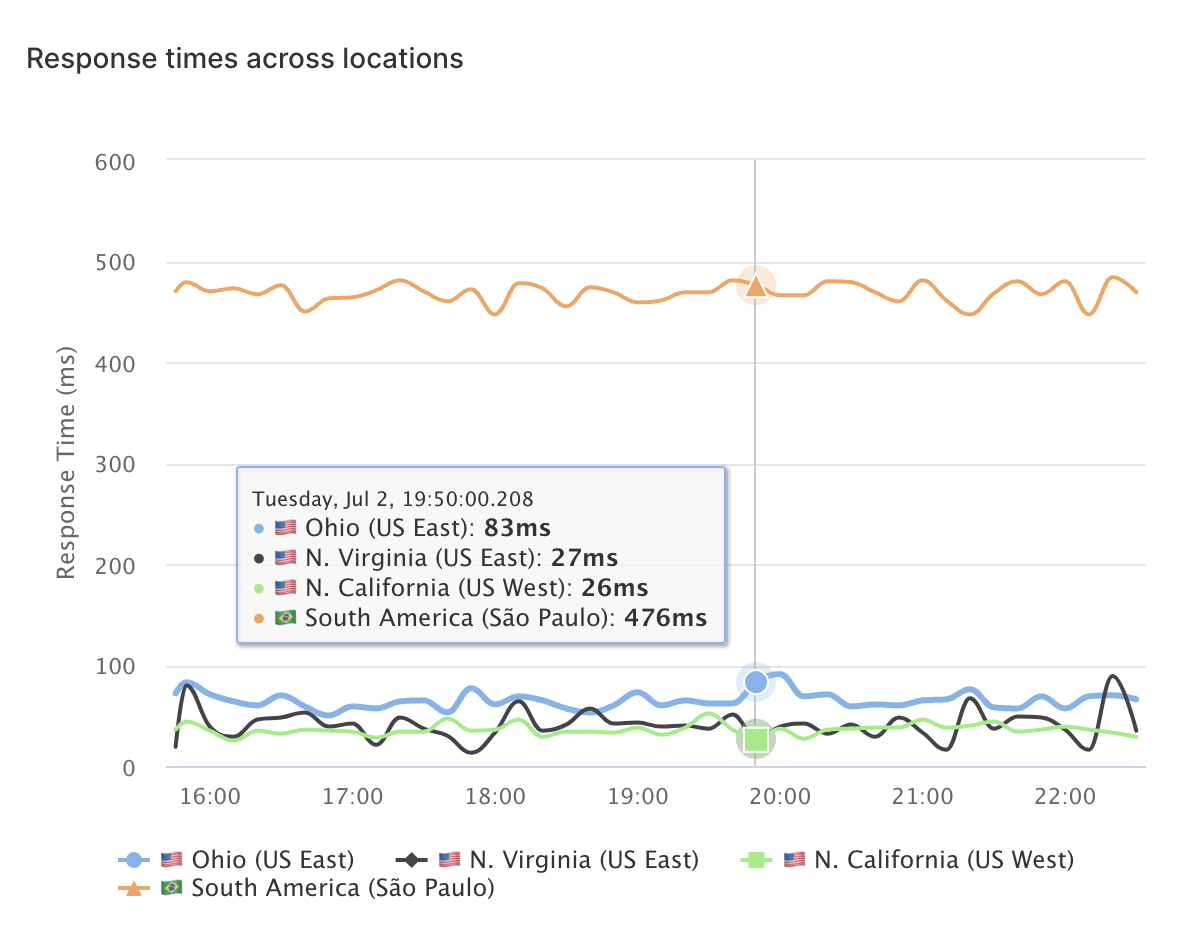

Zeit, die die langsamsten 5% der Requests brauchen. Durchschnittswerte verstecken den Long Tail; p95 deckt ihn auf. Ein p95 über 500 ms bei einer Payment-API heißt: echte Nutzer warten länger als sie tolerieren — und nicht alle kommen zurück.

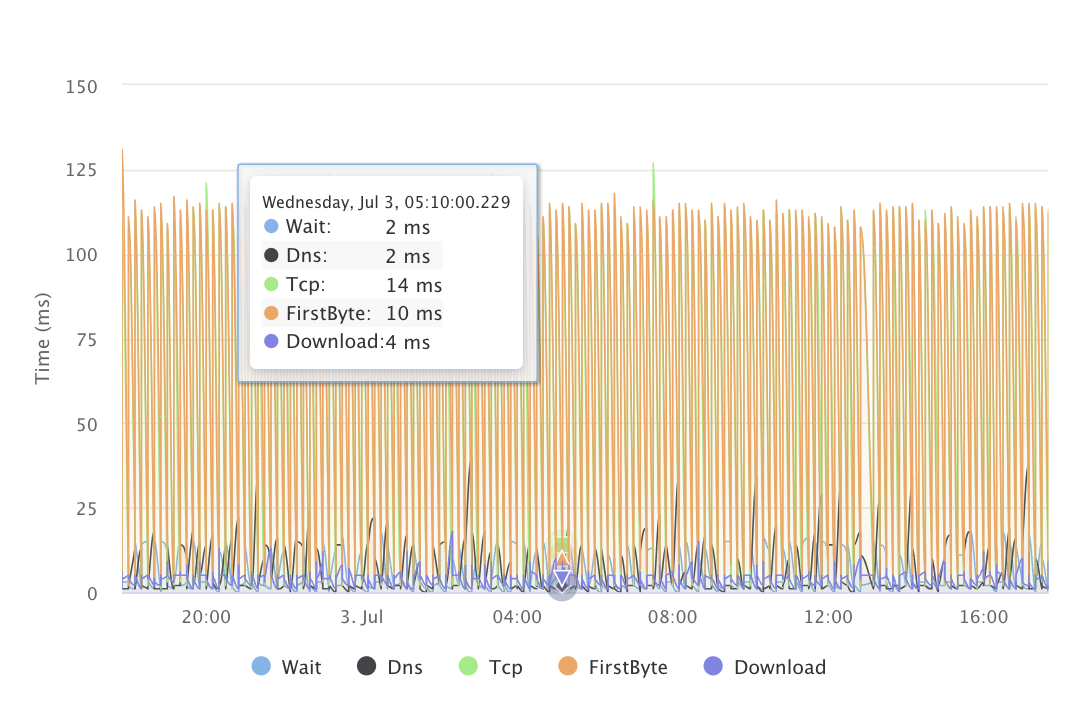

TTFB (Time to First Byte)

Wie lange die API braucht, um das erste Byte nach dem Eintreffen des Requests zu senden. Fängt DNS-, TLS- und Server-Processing-Slowdowns separat vom Netzwerk-Transfer ab. Spikes hier zeigen meist auf den Origin, nicht auf das Client-Netzwerk.

Synthetic-Check-Erfolgsrate

Anteil der Synthetic-Checks, die bestehen (korrekter Status-Code + Response-Shape + innerhalb des Latenz-Budgets). Werte unter 99% bei einer Production-API sind ein alarmierungswürdiger Vorfall, kein Kuriosum.

Real-User-Monitoring-(RUM-)Korrelation

Synthetic-Checks sagen dir, dass die API läuft; RUM sagt dir, ob echte Kunden dasselbe erlebt haben. Beide kombinieren — Synthetic alarmiert dich bei Outages, RUM zeigt den Kunden-Impact.

API-Monitoring — Häufig gestellte Fragen

Wie oft sollte ich eine API checken?

Production-APIs, die Umsatz treiben oder andere Systeme blockieren: alle 30–60 Sekunden. Interne oder unkritische APIs: alle 5 Minuten reicht. Unter 30 Sekunden kostet mehr, ohne nennenswert mehr Outages zu fangen.

Was ist der Unterschied zwischen Uptime-Monitoring und API-Monitoring?

Uptime-Monitoring prüft nur, ob der Endpoint antwortet. API-Monitoring validiert zusätzlich Status-Codes, Response-Body-Shape, Latenz-Budgets und verkettete Workflows (Login → Token → Call). API-Monitoring fängt die stillen Brüche, die Uptime-Monitoring verpasst.

Kann ich authentifizierte APIs monitoren?

Ja — LoadFocus unterstützt Header, OAuth-Bearer-Tokens und verkettete Requests, bei denen die Response eines Schritts (ein Token) zur Auth des nächsten wird. Kein Service-Account-Passwort im Klartext-Config nötig.

Wie schnell erfahre ich von einem Outage?

Innerhalb eines Check-Intervalls. Mit 30-Sekunden-Checks und Slack-/PagerDuty-Alerts wird dein On-Call in unter einer Minute gepaged. Konfiguriere Alert-Schwellen so, dass 2 aufeinanderfolgende Failures erforderlich sind — das unterdrückt Single-Region-Transienten.

Funktioniert API-Monitoring für GraphQL und gRPC?

Ja — GraphQL ist nur ein POST mit JSON-Body, voll unterstützt. gRPC braucht einen kleinen Adapter (gRPC-Web oder curl über h2) — die meisten Teams hüllen es rein fürs Monitoring in einen dünnen REST-Proxy.

Was kostet API-Monitoring im Maßstab?

LoadFocus-Preise skalieren mit Endpoints × Frequenz. 50 Endpoints bei 1-Minuten-Checks laufen bei ~19 €/Monat. 500 Endpoints bei 30-Sekunden-Checks sind etwa 180 €/Monat — etwa die Hälfte dessen, was Pingdom oder Datadog für vergleichbare Coverage berechnen.

Du verdienst bessere Testservices

AI-gestützte Load-Test-Analyse in allen kostenpflichtigen Plänen enthalten. Testen Sie die Last von Websites, messen Sie die.Beginne jetzt mit dem Testen→