Overvågning af motorens sundhed

Forståelse af motorens sundhed

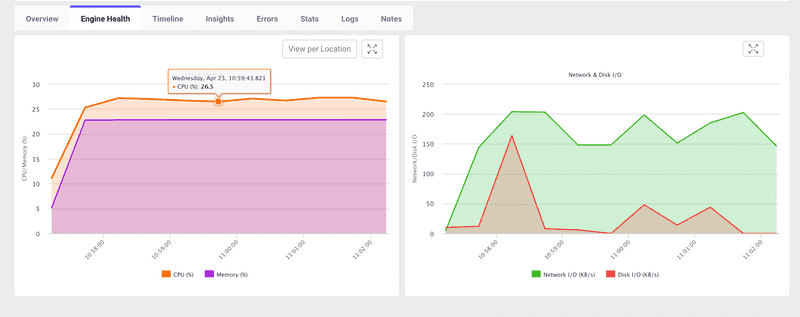

Når du kører dine JMeter-testfiler på LoadFocus, er det afgørende at holde øje med sundheden af dine belastningsmotorer i realtid. Visningen Engine Health viser dig vigtige systemmålinger -- CPU, hukommelse, netværks-I/O og disk-I/O -- for hver af dine testagenter. At spore disse målinger hjælper dig med at opdage ressourcemætning, finde flaskehalse og sikre, at dine belastningsgeneratorer yder som forventet.

Målinger sporet i realtid

- CPU (%) Procentdelen af CPU-kerner udnyttet af din JMeter-motor.

- Hukommelse (%) Andelen af RAM forbrugt af JMeter-processen.

- Netværks-I/O (KB/s) Gennemløb af data sendt og modtaget af motoren over netværket.

- Disk-I/O (KB/s) Læse/skrive-aktivitet på motorens filsystem (f.eks. til logning eller midlertidige filer).

Hvorfor overvåge motorens sundhed?

Forebyg ressourcemætning Motorer, der kører ved eller tæt på 100% CPU eller hukommelse, kan forvrænge testresultater eller endda gå ned, hvilket fører til falske negativer i din ydeevneanalyse.

Identificer flaskehalse Stigninger i netværks- eller disk-I/O kan indikere problemer med resultatindsamling, logning eller infrastrukturbegrænsning.

Optimer testinfrastruktur Ved at forstå ressourceforbrugsmønstre kan du tilpasse dine agenter -- vælge de rigtige instanstyper eller skalere horisontalt.

Sikr testnøjagtighed Sunde motorer leverer ensartet belastning. Enhver forringelse af motorens ydeevne kan introducere variabilitet i din test, hvilket gør det sværere at drage pålidelige konklusioner.

Hvor finder du Engine Health i LoadFocus-brugergrænsefladen

- Start din JMeter-testkørsel som normalt.

- Klik på fanen Engine Health i testresultatdashboardet.

- Skift View per Location for at se målinger grupperet efter geografisk eller cloud-region.

- Hold musen over ethvert punkt på grafen for at vise nøjagtige værdier og tidsstempler.

Sådan fortolker du Engine Health-målinger

- Vedvarende CPU > 80% Din motor er tæt på sin behandlingsgrænse. Overvej at tilføje flere agenter eller bruge større instanstyper.

- Hukommelse > 85% Højt hukommelsesforbrug kan udløse garbage collection-pauser i JMeter. Hvis din test kører længe, se på heap-tuning eller tilføj mere RAM.

- Netværks-I/O-stigninger Pludselige stigninger kan pege på store fildownloads, logningsudbrud eller netværksbegrænsning fra din cloud-udbyder.

- Disk-I/O-toppe Hyppige læse/skrive-stigninger kan bremse resultatindsamlingen. Flyt logfiler til fjernlager eller brug hurtigere lagring.

Bedste praksis

- Skalér horisontalt Fordel dine virtuelle brugere på tværs af flere motorer for at undgå overbelastning af en enkelt maskine.

- Baseline dine agenter Kør en lille pilottest for at fange ressourcebaselines, før du skalerer op til fuld belastning.

- Korrelér med testresultater Kortlæg altid ydeevneforringelser tilbage til motormålinger -- antag ikke, at applikationsserverne alene er skyld i problemet.

- Eksternaliser logfiler Omdirigér JMeter-logfiler til eksternt lager eller deaktiver detaljeret logning for at reducere disk-I/O-overhead.

Konklusion

Realtids overvågning af motorens sundhed i LoadFocus giver dig indsigt i ressourceudnyttelsen af dine JMeter-agenter. Ved at overvåge CPU, hukommelse, netværk og disk-I/O-målinger kan du proaktivt opdage og løse infrastrukturrelaterede problemer -- og sikre, at dine belastningstests forbliver nøjagtige, pålidelige og skalerbare.